Labelen zolang de zon schijnt

Andrzej Gdula via Unsplash

Is de tekst die je leest op een website van de publieke omroep wel echt geschreven door een mens? En die beelden die je ziet op TV, zijn dat wel echte beelden? En de stem van de nieuwslezer op de radio, komt die niet uit de computer? Het zijn vragen die tien jaar geleden te bizar zouden zijn om te stellen, maar nu door de snelle ontwikkeling in AI steeds vaker gesteld zullen worden. In de mailbox van de Ombudsman komen tot nu toe vrij weinig vragen over het gebruik van AI door de journalistieke redacties van de omroepen. Om dat ook zo te houden, is het verstandig om te labelen wat we wel en niet met AI doen.

In de Code Journalistiek Handelen staat sinds vorig jaar één zin over het gebruik van AI. Er staat: “Journalisten van de Publieke Omroep beslissen of en hoe AI wordt ingezet, en blijven eindverantwoordelijk voor de inhoud.” Dit maakt in elk geval duidelijk waar de verantwoordelijkheid ligt voor het gebruik. Maar het zegt niets over wat er wel en niet gedaan wordt met de nieuwe tools. Voor het publiek blijft het ook met deze regel een black box.

De code bevat alleen afspraken voor journalistieke programma's bij de publieke omroepen. Maar er zijn binnen de NPO ook regels opgesteld voor het gebruik van AI die voor álle programma's gelden, bijvoorbeeld ook voor dramaproducties of amusement. In die regels staat iets meer. Bijvoorbeeld dat veiligheid en betrouwbaarheid voorop staan bij het gebruik van (generatieve) AI en dat omroepen transparant moeten zijn over de inzet van de tools. Je zou deze regels kunnen lezen als een soort grondwet voor AI-gebruik, met algemene beloftes aan het publiek. En dat is zeker een goed begin, maar deze regels zullen voor het grote publiek geen duidelijkheid geven. Daarvoor zijn ze te algemeen en bovendien te vinden op een plek waar niet veel mensen zullen komen.

Het publiek vraagt om transparantie

En dat is een probleem. Want het publiek wil wel degelijk meer van ons weten. Dat blijkt onder andere uit onderzoek van Trusting News en de Online News Association in de VS in 2024. Daarin gaf maar liefst 94% (meer dan negen op de tien mensen) van de ondervraagden aan meer transparantie over het journalistieke gebruik van AI te willen. Maar wat er precies gedeeld moet worden met het publiek, en wanneer wel of niet, is ook bij het publiek zelf nog lang niet altijd even duidelijk.

Dat het publiek beslist niet alles wil weten, blijkt onder andere uit onderzoek van het Poynter Institute. Als een journalistiek artikel een label krijgt dat wijst op het gebruik van AI zorgt dat voor wantrouwen, in elk geval bij een deel van het publiek. Dus het publiek wil dat de journalistiek open is over het gebruik van AI, maar beloont dat door het eindproduct minder te vertrouwen. Met andere woorden: transparantie wordt niet beloond en dat levert een dilemma op.

AI is overal

Gerson Veenstra van EenVandaag deed op LinkedIn de suggestie om dan maar vooral te labelen wat door mensen gemaakt is. Want labelen wat door AI gemaakt is, is al bijna niet meer te doen, zo schreef hij: "Aan het begin was dat nog niet zo'n gekke gedachte. Toen was de hoeveelheid AI-materiaal nog beperkt en kwam je het amper tegen. Hoe anders is dat nu. Open een willekeurige tijdlijn en je wordt overspoeld met AI-materiaal.”

Op sociale media is het inderdaad vrijwel niet meer te doen om te ontkomen aan AI-gegenereerde content. De grote platforms zoals YouTube, LinkedIn, Facebook en Instagram staan vol met nepfoto's en video's. Ook reclameboodschappen op TV worden steeds vaker met AI gemaakt en zelfs Hollywood gaat er mogelijk niet meer aan ontsnappen met de introductie van de volledig door AI-gemaakte actrice Tilly Norwood of de virale (maar neppe) vechtscene tussen Tom Cruise en Brad Pitt.

Dus dan maar labelen wat wel echt menselijk is? De Ombudsman is bang dat ook dat niet de oplossing gaat bieden. Vooral niet in de journalistiek. Want hoewel we in de journalistiek erg terughoudend zijn met het inzetten van door AI gegenereerde plaatjes en video's, worden de AI-tools voor andere zaken zeker al wel gebruikt.

Zo wordt AI gebruikt om bijvoorbeeld grote hoeveelheden data te analyseren. Of om audio te transcriberen. Het maakt het voor journalisten mogelijk om efficiënter en in sommige gevallen beter onderzoek te doen. Maar AI wordt ook ingezet om bijvoorbeeld teksten toegankelijker te maken voor een breed publiek of om een goede kop boven een artikel te krijgen. En er zijn zelfs voorbeelden van complete artikelen die geschreven worden door AI-tools.

Het simpel labelen van wat menselijk is en wat niet, is daardoor nog niet zo eenvoudig. Want waar leg je dan de grens? Als je via Google op zoek bent gegaan naar bepaalde bronnen zet je eigenlijk ook AI in. Mag je dan nog altijd het label ‘menselijk’ gebruiken voor wat je publiceert aan de hand van die bronnen? En hoe zit het met je spellingchecker? Ook dat is een vorm van AI.

BBC-labels

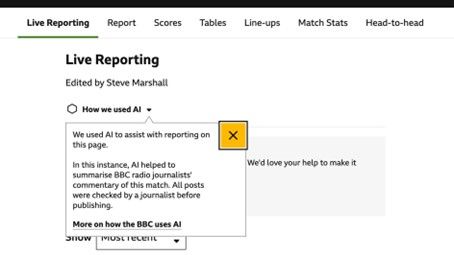

De BBC is eind vorig jaar begonnen met het labelen van AI-gebruik. Zo verschijnt er onder andere een label op de website bij sportwedstrijden die ook live op de radio worden uitgezonden. Wat de sportcommentatoren op de radio zeggen, wordt door AI omgezet in een bericht voor de website. Boven een dergelijk bericht verschijnt vervolgens een label dat precies dit proces uitlegt. Ook wordt er nog expliciet bij vermeld dat er nog een menselijke check wordt uitgevoerd op het bericht vóór het daadwerkelijk geplaatst wordt.

Maar ook bij de BBC worstelen ze met de vraag wat je wel en wat je niet moet labelen. Uit eigen onderzoek van de Britse omroep bleek dat het publiek niet zit te wachten op een label op alles. Zo hoeft het checken van spelling echt niet voorzien te worden van een etiket. Waar het publiek wel labels verwacht was ook duidelijk. Als AI daadwerkelijk invloed had op de inhoud van het journalistieke eindproduct.

En het gaat daarbij niet enkel om een etiket met uitleg over hoe AI werd gebruikt. Het publiek wilde vooral ook weten waarom de omroep er voor koos om de extra hulplijn in te zetten. En, niet onbelangrijk, wat de toegevoegde waarde daarvan voor het publiek zelf was.

Transparantie in een drietrapsraket

Bij de publieke omroep in Nederland wordt op dit moment nog niet standaard gewerkt met het labelen van content. Toch zou het goed zijn als ook hier geëxperimenteerd gaat worden met een vorm van labelen. Ook om te voorkomen dat het door externe partijen gaat worden opgelegd. Zo wordt er momenteel in Europa gewerkt aan de Europese AI Act. Die wet verplicht mediaorganisaties om AI-gegenereerde teksten die het publiek informeren over maatschappelijke kwesties duidelijk te labelen.

De wet kent op dit moment een belangrijke uitzondering. Content die menselijke redactionele controle heeft ondergaan en waarbij een mens eindverantwoordelijk is (zoals ook omschreven in de Code Journalistiek Handelen) hoeft niet gelabeld te worden. Maar als de journalistiek niet zelf aan de slag gaat met het zichtbaar maken van AI-gebruik valt niet uit te sluiten dat er in de toekomst toch wettelijke verplichtingen komen. Het is wat de Ombudsman betreft een extra reden om nu al aan de slag te gaan.

We kunnen daarbij kijken naar het voorbeeld van de Britten. Het label dat zij plaatsen boven artikelen bestaat uit een simpel tekentje dat extra informatie geeft op het moment dat je erop klikt. Dit voorkomt dat het te overheersend wordt en het lezen van het daadwerkelijke artikel in de weg gaat zitten.

Voor de inhoud van het label pleit de Ombudsman voor een drietrapsraket, die ieder artikel zou kunnen krijgen, en die voor iedereen duidelijk maakt hoe groot de invloed was van AI op het uiteindelijke journalistieke product. Het gaat om de labels AI-gefaciliteerd, AI-geassisteerd en AI-gegenereerd.

Label 1: "Minimale bewerking door AI": Gebruikt voor basistaken zoals transcriptie, vertaling of spellingcontrole. Deze toepassingen zijn vergelijkbaar met een rekenmachine of tekstverwerker. Nuttige gereedschappen die geen directe invloed hebben op de inhoudelijke keuzes.

Label 2: " Ondersteund door AI": AI hielp bij data-analyse, het structureren van informatie of het opstellen van conceptteksten, maar de journalist deed zelf het grootste gedeelte van het onderzoek, maakte de inhoudelijke keuzes en schreef het uiteindelijke stuk.

Label 3: "Geschreven door AI": De output is door AI gemaakt. Dat gebeurde weliswaar onder menselijke supervisie en controle, maar de invloed van AI op vorm en inhoud is groot. Zo kan de tekst volledig geschreven zijn door de AI. Dit vereist een prominent label bovenaan het artikel, zodat lezers direct weten waar ze aan toe zijn.

Deze drie labels geven het publiek meer inzicht in waar in het journalistieke proces AI is gebruikt. Essentieel is ook om op te merken dat bij Label 3 (het zwaarste gebruik van AI) nog altijd sprake is van menselijke controle. Dat laat eventueel nog ruimte voor een label 4 waarbij er helemaal geen mens meer aan te pas komt. De vraag is echter of je dan überhaupt nog kunt spreken van journalistiek.

Slot

De Ombudsman bepaalt niet hoe de journalisten van de publieke omroep transparantie over AI-vorm gaan geven. Uiteindelijk beslissen redacties en omroepen dit zelf. Ze zijn nu nog heel voorzichtig met het gebruiken van AI, maar ze lijken mogelijk nóg voorzichtiger met het vertellen over wat ze achter de schermen al wél doen.

De voorbeelden uit het buitenland laten zien dat het publiek vraagt om transparantie. Nu AI een steeds zichtbaardere rol speelt in alles wat mensen horen, zien en lezen, is de urgentie om meer te doen met de zichtbaarheid van AI-gebruik hoog. Je moet het dak repareren als de zon schijnt. Op dit moment schijnt de zon, want mensen klagen nog niet erg over het gebruik van AI. Maar de eerste druppels zijn voelbaar en het zal ooit gaan regenen. Als er steeds meer klachten gaan komen over of iets wel of geen AI is, dan zullen de redacties daar een antwoord op moeten hebben. Met deze voorzet vanuit de Ombudsman hopen we het gesprek bij redacties op gang te brengen.

Dit artikel zou overigens het label “Ondersteund door AI" krijgen. Voor het onderzoek naar de huidige stand van zaken in de wereld van AI-labels werd een AI-tool gebruikt. De gevonden bronnen werden echter door een mens gelezen, gecheckt en geanalyseerd en de tekst zelf is volledig geschreven door een mens.