De werkelijke wereld van Maduro met muts

De beelden zien er in eerste instantie wat koddig uit. De president loopt in de video op slippers met een ietwat gek mutsje op door de gang van een politiebureau in New York. Hij draagt handboeien en wordt geflankeerd door twee politieagenten. Een derde loopt achter hem. Aan het einde van het filmpje zegt de president “Happy New Year” tegen iemand buiten beeld. Het filmpje wordt over de hele wereld gebruikt in nieuwsuitzendingen en op websites. Ook door de NOS. Maar het is zo'n vreemd beeld dat sommigen de vraag stellen of dit misschien gemaakt is door AI. En of de NOS het daarom beter niet kan gebruiken?

"In de berichtgeving omtrent de vermeende arrestatie van Maduro heeft de NOS een AI-gegenereerde foto als echt gepresenteerd (...). Overigens viel het mij direct op dat dit geen echte foto was. En als ik dat als lezer kan zien, zou een journalist/redacteur dit zeker moeten zien,” schreef een kijker. De Ombudsman ging op zoek en kwam er al snel achter dat het door de NOS gedeelde filmpje wel degelijk echt is.

De video is afkomstig van Rapid Response 47, een officieel account van Het Witte Huis. Vanwege de hoge nieuwswaarde (één van de eerste bewegende beelden van de ontvoerde Venezolaanse president Maduro) werden de beelden door persbureau Reuters internationaal verspreid. De video is ook nog altijd te vinden op de site van Reuters. Soms is de werkelijkheid zo onwaarschijnlijk dat zelfs AI haar niet had kunnen bedenken.

Dubbelklik op de foto om naar de oorspronkelijke video te gaan.

Dubbelklik op de foto om naar de oorspronkelijke video te gaan.

AI Maduro

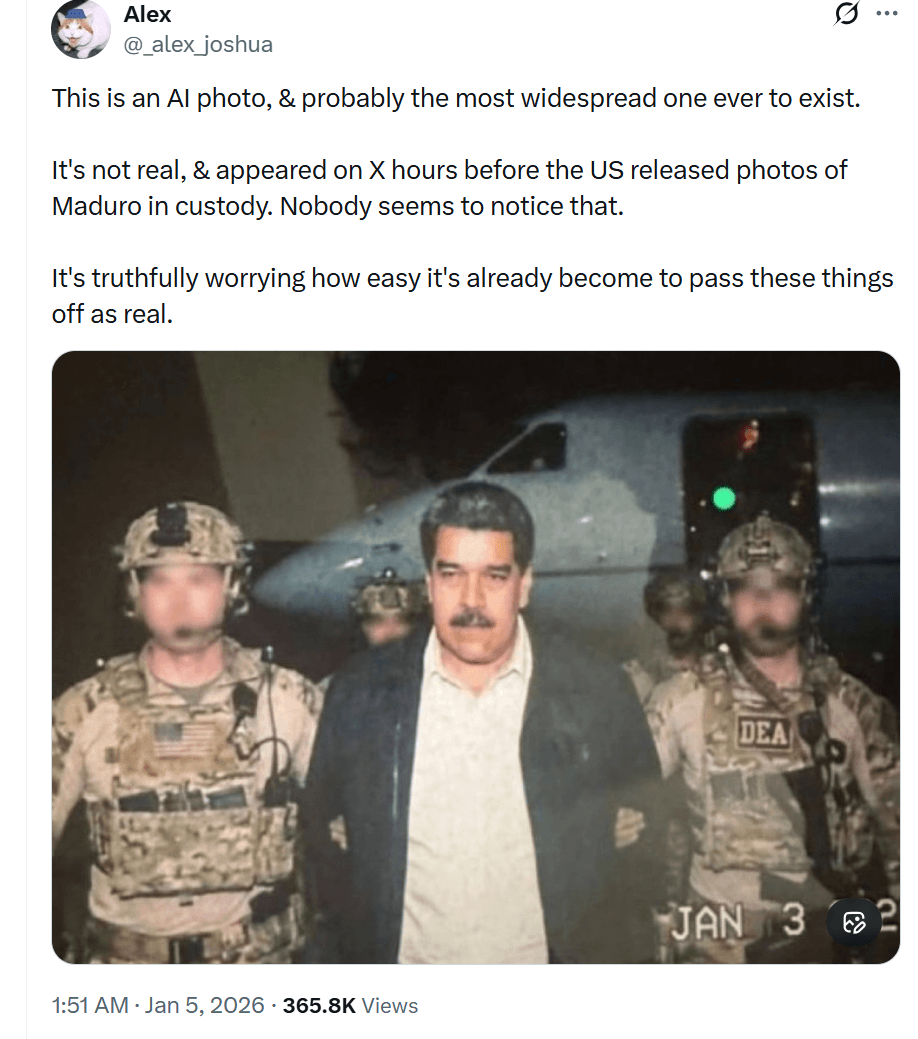

Toch is het geen gekke gedachte van deze mailer. Er gingen immers wel degelijk (veel) door AI gegenereerde plaatjes rond die de gearresteerde Maduro zouden laten zien. Zo was er de foto die boven dit artikel staat. Op deze foto draagt de Venezolaanse president een witte polo met daaroverheen een jas. De foto verscheen redelijk snel nadat president Trump op sociale media bekend maakte dat Maduro was opgepakt door de Amerikanen. Dit beeld is echter wel degelijk door AI gemaakt, maar dat was niet voor iedereen meteen duidelijk.

In een breaking nieuws-situatie gaan niet alleen journalisten op zoek naar nieuwe informatie, maar doet ook het publiek dat. Je zoekt bevestiging van geruchten en wat is nu een betere bevestiging dan dat wat je eigen ogen zien? Deze eerste foto leek veel van wat er gezegd werd te bevestigen. Hier zien we president Maduro geflankeerd door wat in elk geval lijkt op Amerikaanse special forces. Als klap op de vuurpijl draagt één van de twee militairen ook nog eens de letters DEA (Drug Enforcement Administration) op zijn borst. Wat je hier ziet, lijkt compleet te kloppen met wat er in het nieuws voorbijkwam. Geen wonder dus dat mensen de foto massaal verspreidden.

De foto verscheen op een moment dat er nog geen officiële foto's vrijgegeven waren door de Amerikaanse overheid of door erkende persbureaus. Sterker nog: de Venezolaanse regering deed een oproep aan de Amerikanen om te laten zien dat Maduro nog leefde. Er was veel onduidelijk en toen kwam opeens deze foto tevoorschijn. En zo waren er nog een paar die gretig gedeeld worden. Tot grote verbazing van experts. “This was the first time I’d personally seen so many A.I.-generated images of what was supposed to be a real moment in time”, zei Roberta Braga van het Digital Democracy Institute of the Americas in een artikel in de New York Times. Dit instituut deed onderzoek naar hoe er online werd gesproken over de arrestatie van Maduro en kwam daarbij de AI-plaatjes regelmatig tegen.

Echt of nep

De mailer die dacht een AI-foto bij de NOS ontdekt te hebben, schreef de Ombudsman dat ze blij was dat de NOS in dit geval geen AI-foto had gebruikt. Maar helemaal gerustgesteld was ze nog niet: “Mijn zorg blijft wel de snelheid waarmee nepbeelden verspreid worden en de transparantie over de herkomst van afbeeldingen in het nieuws.”

De arrestatie van Maduro en het grote aantal AI-beelden die online verschijnen laten inderdaad zien dat wat de mailer zegt iets is om je zorgen over te maken. Het gaat daarbij overigens niet alleen om AI-beelden, maar ook om beelden die gedeeld werden met een verkeerde context. Zo werden video's van andere gevechtssituaties (Iran, Oekraïne, Gaza) gedeeld alsof het beelden waren van de Amerikaanse acties in Venezuela.

Sinds de komst van het internet en de sociale media is de wens om snel nieuwe informatie te publiceren ook bij nieuwsorganisaties groter dan ooit. Het publiek vraagt immers om constante updates, zeker bij een nieuwsgebeurtenis met de impact van wat er in de eerste week van 2026 in Venezuela gebeurde. De concurrentie van nieuwsorganisaties onderling en nieuwe verspreiders van nieuws op sociale media is groot.

Foto's die rondgaan op sociale media bereiken het publiek en dat stelt al snel de vraag waarom bijvoorbeeld de professionals van de NOS die foto’s nog niet gepubliceerd hebben? Zit daar misschien iets achter? De druk om te publiceren is dan ook groot. Maar daar waar iemand op sociale media vrij makkelijk iets online kan slingeren, is het belangrijk voor journalistieke redacties om juist vaker dan in het verleden op de rem te trappen.

Niet de snelheid is het belangrijkste, maar dat de informatie klopt. Niet voor niets staat in de Code Journalistiek Handelen: “Omroepmedewerkers berichten waarheidsgetrouw, de informatie klopt. De producties zijn controleerbaar en worden gecheckt.” Iedere foto, zeker van twijfelachtige bron, zal moeten worden gecontroleerd. Pas als een redactie 100% zeker is dat een foto echt is, zou die gepubliceerd moeten worden.

Check, check, dubbelcheck

Maar wat check je dan precies? En hoe? Eerst en vooral is het belangrijk om de overweging te maken hoe betrouwbaar de foto binnengekomen is. Komt het van een gerenommeerd persbureau zoals Reuters of van het Nederlandse ANP, dan kun je ervan uitgaan dat zij een aantal noodzakelijke checks al hebben gedaan. Ook als het komt van de eigen journalisten of vaste (foto)correspondenten dan hoef je als redactie niet zo snel te twijfelen aan wat je binnenkrijgt.

Komt het van een voor jou onbekende bron, dan is er natuurlijk aanleiding om goed te kijken naar een foto (of video). Een vrij makkelijke en snelle check daarbij is of de foto overéénkomt met andere beelden die online verschenen zijn. Zo viel de AI-foto van Maduro in de witte polo al snel door de mand toen er andere foto's online verschenen waarop hij andere kleren aan had. Nu bestaat de kans dat hij onderweg andere kleren aan had gekregen, maar erg waarschijnlijk was dat niet.

Ook kun je kijken of de foto of video overéénkomt met andere informatie die je kunt vinden. Regent het op de foto, terwijl het volgens het weerbericht een stralend zonnige dag was? Dan is de kans groot dat er iets niet klopt. Of, in het geval van de AI-foto van Maduro: wordt door officiële bronnen gezegd dat de Venezolaanse president met een helikopter vervoerd is vanuit Caracas, maar staat er op de foto een vliegtuig? Opnieuw een sterke aanwijzing dat er iets niet klopt.

Maar wat als je geen extra informatie hebt? Geen schriftelijke, maar ook geen visuele? Dan wordt het ingewikkelder en zul je wat technische trucjes uit moeten halen. De eerste, en de makkelijkste, is om te kijken of de foto die je hebt gekregen niet van een eerdere nieuwsgebeurtenis is. We zagen al eerder dat in oorlogssituaties foto's vaak gerecycled worden. Zo kan een foto van een bombardement in Gaza in 2014 opeens gebruikt worden als onderdeel van een nieuwsverhaal over een aanval op Iran in 2025.

Om erachter te komen of je te maken hebt met ‘gerecycled’ materiaal kun je je foto uploaden naar één van de vele online tools die er zijn om de herkomst van een bepaald beeld op te zoeken. De meest voor de hand liggende optie is Google Afbeeldingen. Wie hier bijvoorbeeld de foto van AI-foto van Maduro uploadt, krijgt honderden links te zien van social media-accounts waar de foto is gedeeld. Maar wie doorklikt naar ‘over deze afbeelding’ komt onder andere op deze factcheck. (Opvallend is dat er ook nog altijd een aantal buitenlandse nieuwssites naar boven komt dat de foto wel als waar opgenomen heeft in de berichtgeving).

Naast Google bieden ook TinEye, Yandex en Bing een soortgelijke 'reverse image search’-dienst. Maar dit werkt alleen als de foto al eerder elders online is verschenen. Als dat niet het geval is, is het checken ook meteen een stuk ingewikkelder. Zo is er geen 100% betrouwbare AI-check. Er zijn online wel verschillende websites te vinden die beloven dat ze AI-foto's kunnen herkennen, maar dat blijkt niet het geval. De Ombudsman heeft de AI-foto van Maduro online ingevoerd bij tien verschillende websites die AI zouden moeten herkennen, maar geen van alle zag de foto aan voor een product van AI. Toch zijn verschillende factcheckers er wel in geslaagd om met technische hulpmiddelen te bewijzen dat het AI is. Zo kun je in de betaalde versie van Gemini zoeken naar de zogenaamde SynthID. Dit is een digitaal watermerk dat de AI-tools van Google achterlaten op alles dat ze maken. In dit geval werd dit watermerk op het origineel gevonden. Een extra aanwijzing was dat de eerste persoon die de afbeelding verspreidde op X zichzelf omschrijft als “AI video art enthousiast”.

Addertje onder het gras is dat je deze tool alleen met Google kunt gebruiken en dat zo alleen met Google gemaakte AI-plaatjes kunnen worden ontdekt. Andere factcheckers maakten gebruik van een speciale plugin voor de Chromebrowser waarmee je foto's en video's kunt laten verifiëren. Deze tools tonen met vrij grote mate van waarschijnlijkheid aan dat het plaatje nep was. De absolute zekerheid daarover kwam echter pas toen er ook officiële foto's verschenen. Het beeld dat die foto's lieten zien pasten niet bij het beeld dat opgeroepen werd met de AI-foto. Zo droeg Maduro op de officiële foto's andere kleren dan op de AI-foto.

Conclusie

Het maken van een AI-foto is makkelijk. Met enkele clicks heb je een overtuigend beeld van een clown op een tank of een ijsbeer op ski’s. Aantonen dat het beeld niet echt is, is vele malen ingewikkelder. Bij die clown of die ijsbeer is het gezond verstand er al snel van overtuigd dat hier een loopje wordt genomen met de werkelijkheid. Bij een foto van Maduro die gearresteerd is, is dat toch net iets anders. Je hebt er iets over gehoord en nu zie je datzelfde (of iets dat er op lijkt) voor je ogen gebeuren.

Het gemak waarmee met AI een niet bestaande werkelijkheid gecreëerd kan worden, vraagt een verhoogde waakzaamheid en bewustzijn van de journalistiek. In afgelopen jaren gaat het gelukkig veel en vaak over AI, ook bij de publieke omroepen. Zo kreeg onlangs de Code Journalistiek Handelen een update over hoe men om gaat met AI. De journalistieke redacties lijken voorzichtig met het inzetten van de beschikbare tools en ook voorzichtig met het gebruiken van wat er binnenkomt. In de afgelopen jaren heeft de Ombudsman dan ook niet vaak klachten gehad over vermeende fouten van de journalistieke redacties met AI-beelden.

Toch ging het een enkele keer fout bij de NOS. Bijvoorbeeld toen er AI-gegenereerde pinguïns werden getoond in het NOS-journaal. Toen dat ontdekt werd, deed de NOS precies wat je van de publieke omroepen mag verwachten: de fout publiekelijk toegeven en uitleggen hoe het kon gebeuren. In de herstelrubriek van de NOS staat ook beschreven hoe een AI beeld van een aanval op een Iraanse gevangenis in het 20.00 journaal terecht kwam en hoe een stockfoto van een vrachtschip afkomstig uit een grote professionele beeldbank AI bleek te zijn, zonder dat het in de omschrijving vermeld werd.

De mail die de Ombudsman kreeg naar aanleiding van de arrestatie van Maduro geeft aan dat ook het publiek zich bewust is van de risico's van AI. En dat stemt hoopvol. Want niet alleen de journalistiek moet zorgvuldig omgaan met de nieuwe AI-realiteit. Dat geldt ook voor het publiek. Check voor je deelt. Alleen zo blijven we leven in de werkelijke wereld zonder ijsberen op ski's en met Maduro met muts.

In een eerdere versie van dit artikel stond in de op één na laatste alinea dat het slechts één keer was gebeurd dat de NOS AI-beelden had gebruikt. Dat bleek bij nader onderzoek niet correct en is aangepast.